|

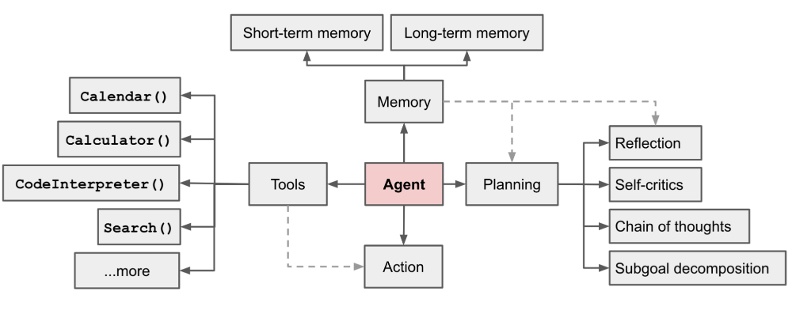

2024年初接受《遠見》專訪時,欧博abg人工智慧大師吳恩達(Angrew Ng)便興奮表示,AI代理(AI Agent)是2024年最值得關注的AI趨勢之一。Google CEO皮蔡(Sundar Pichai)在同年年底高喊已經進入代理時代(Agentic Era),《經濟學人》更在年末AI預測引述專家說法表示,Agent有望讓人們從「對話走向執行」,這將是2025年最大的科技突破之一。為何AI Agent備受關注?所謂「AI代理工作流程」(AI agentic workflow)又是什麼?即便萬眾矚目,但AI Agent產品仍未大規模落地,有哪些挑戰橫亙於眼前?《遠見》一文帶你看。 【目錄】 AI Agent,指的是能夠自主(autonomous)做出決策、完成行動,而且毋需人類介入的人工智慧。 AI Agent在人類下達複雜指令(prompt)以後,利用感知到的環境資訊,結合指令內容,自行做出計畫,並將其分解成不同步驟,並採取相應行動;在執行任務以後,它還能夠把行動後接收到的回饋,用以改進自己的行為,轉變為下次出任務的養分。 台灣將AI Agent翻譯成AI代理,對岸則用AI智能體稱之,無論是哪種用詞,都能清楚看到AI Agent的特性,既擁有智慧(intellegence),又具備作為人類代理(agent)的能力。 無論是面向消費者(2C)或者面向企業(2B),AI代理服務已經初見雛形,中信證券(CITIC Securities)更在研究報告表示,2024年就是AI代理的落地之年。 延伸閱讀:AI Agent系列題組 2023年6月,現任OpenAI安全系統負責人、曾領導AI應用研究的研究科學家Lilian Weng曾撰文討論,由大型語言模型驅動的自主代理(LLM Powered Autonomous Agents),應該是什麼模樣。Lilian Weng的文章備受討論,也成為不少個人和企業發展AI Agent時參考的重要模板。 就像人類一樣制訂計畫,還能利用工具做事在Lillian Weng眼中,AI Agent以LLM為大腦,擁有規劃技能(planning skills),具備記憶力(memory),同時能夠調用工具(tool use),因此AI Agent有辦法解決通用問題(general problem),不再是先前專用的人工智慧所能比擬。 就規劃而言,宛若人類在制訂計畫,AI Agent利用思維鏈(chain of thoughts)、思維樹(tree of thoughts)等技術,讓LLM把收到的指令與任務細分為不同步驟,如此便可以把終極目標拆解成子目標(subgoals),方便管理也易於檢核。 另外,在完成任務後,透過ReAct、Reflexion等反思框架以及事後反思鏈(Chain of Hindsight),讓AI Agent不再只是憑空推理,因為針對每次行動給出評價,因此能夠從過去行為中學習,藉此精進未來行動,產出表現更佳的結果。

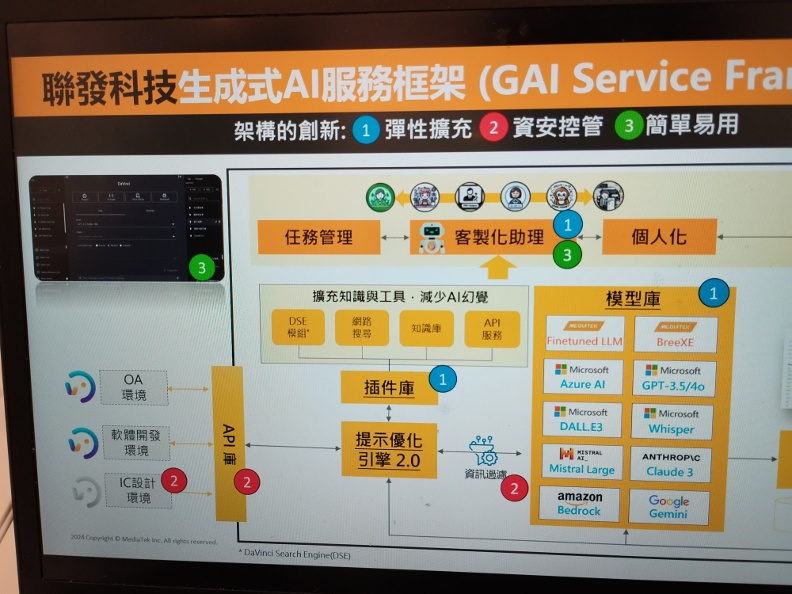

和Lillian Weng的想法類似,鏈奇國際創辦人何建幟補充,感知能力、思考能力和行動能力是AI Agent的必需。AI agent能夠感知世界,因此掌握對環境的認知,知道自己所處的位置;擁有做計畫和決策的能力,並利用感知到的資訊輔助決策品質;有了計畫後採取行動,讓其落地,由此構成AI Agent。 除了以「能力」定義AI Agent以外,也能夠從「特性」面向,觀察AI Agent的特色。 AI Agent 能夠主動提問,且達到個人化與團隊成員一同開發聯發科生成式AI平台「達哥」(DaVinci),聯發科技人工智慧暨數據工程處副處長楊建洲接受《遠見》採訪時表示,AI Agent應該具備個人化(personalization)、主動性(pro-active)、互動適應性(adaptive interaction)、自主學習(learning)以及任務管理(task management)等能力。 對比ChatGPT,AI Agent會主動發起對話,向使用者提出問題;又因為有能力在互動中學習使用者的偏好、習慣,因此體驗上更加親近,做出的決策也更符合個人需求;應對未知情況時,AI Agent有辦法自動生成計畫,並且實際執行。總結來說,AI Agent能夠接受任務、調整任務、執行任務再到回報任務,在他眼裡這才算合格。 楊建洲也補充,當使用者配備AI Agent,將能「Fire and Forget」,也就是人類下指令、分配任務給AI以後,就能上床睡覺,或者回頭專注在其他任務上,不用將時間和精力消耗在與聊天機器人的對話裡面,真正解放認知資源,將工作放心外包給AI。

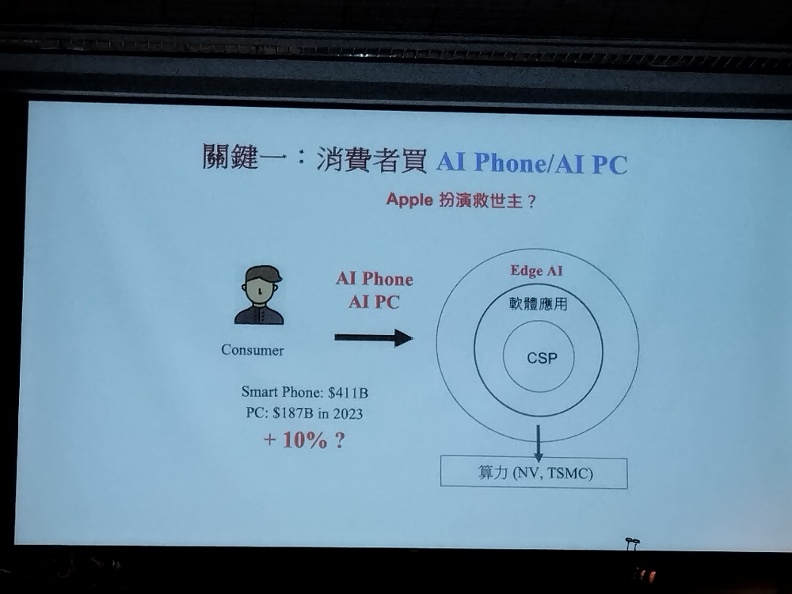

項目 模型 Agent 知識 知識有截止日期(cutoff date),僅具備訓練資料中的知識。 可以利用外部搜尋工具,擴展知識的範圍。 脈絡 以單次查詢回應為主,除非在指令中特別提醒,否則無法「想起」先前對話內容。 能夠記錄並管理多輪對話的歷史,因此對話時較能掌握脈絡。 工具 無法調用工具。 能夠調用工具。 推理 使用者僅能盡量利用提示工程(prompt engineering)技巧引導。 可以調用ReAct等推理框架。 資料來源:受訪者、Google 2025年AI Agent白皮書。整理:曾子軒。2025/01更新。 AI Agent為何興起? 2023年底,比爾蓋茲便預言,AI Agent能夠幫助使用者完成「所有活動」,在理解人類使用的自然語言之餘,更因為具備對使用者的理解,可以個人化地完成任務。他認為AI Agent不只會改變人機互動的方式,更會就此顛覆軟體產業。 雖然比爾蓋茲自陳,早在1995年撰寫的《擁抱未來》(The Road Ahead)一書中,便已提過AI Agent的概念,但直到近來AI研究出現進展,AI Agent才不再是狂想、變得更加實際。 改變的分歧點,正是因為大語言模型有能力扮演腦袋,同時在物理世界和數位世界中發揮影響力。過往,欧博善於生成內容的LLM,看起來宛若「思想的巨人、行動的侏儒」,即便2023年BabyAGI和AutoGPT等專案興起,史丹佛大學和Google研究人員也曾打造出AI小鎮,但AI Agent仍舊是未竟之夢。

DeepLearning.AI工程經理陳奎翰認為,記憶力提升是LLM從對話進化到AI Agent的因素之一。在GPT-3.5時代,LLM能夠吸收的上下文長度(context window)大約還在數千(k)等級,GPT-4提升到以萬(10k)計算,近期出的Claude 3、Gemini 1.5 Pro則暴漲至百萬(M),同時有研究論文以千萬(10M)計算。 「先列出一些範例,告訴它(LLM)你的任務如果是這樣,可以把它拆解。」陳奎翰的說法,其實和過往指令工程(prompt engineering)中,建議使用者多提供幾個範例(few-shot example)的做法相似。 然而,量變帶來質變,隨著LLM能夠記起的內容變得更多,AI Agent的開發者便可以準備更加詳盡的例子讓LLM參照。有記憶力加持,面對陌生情況有足夠的範例可以看,「它會有樣學樣,把收到的任務做拆解,」這也是AI Agent規劃技巧進步的原因之一。 另外,AI Agent具備反思能力,能夠「從做中學」,一般做法是在原先行動的LLM角色以外,增加負責觀察並提供回饋的LLM角色,或者直接評估,又或者引入外部資訊檢查,讓它能夠審視LLM採取的行動,藉此改進。

訂閱遠見電子報,掌握國內外大事 訂閱

陳奎翰補充,除了讓LLM自評行為以外,人類也能夠在LLM行動中間介入。例如在搜尋網站時,LLM研究員列出A、B、C和D四個連結,人類可以在檢查後,告訴LLM應該排除D連結,它便能藉此改進行為,這就是「人類在迴路當中」(human-in-the-loop)的展現。 至於使用工具,則是讓LLM從二維的對話,上升到三維採取行動的關鍵。陳奎翰解釋,當LLM接上網頁搜尋或者其他API等工具,將產生兩大變化,第一是讓LLM補充知識截止點(cutoff)以後的新資訊,第二則是讓它有辦法利用特別格式的文字信號連結外界。 掌握這些能力以後,欧博娱乐LLM從單純產生符元(token)的思想家,變身成大步逛街的行動者。因此標誌出AI Agent實現的開始。 AI Agent調用工具有哪些用途?AI Agent的工具使用功能可以做哪些事?項目 調用API 函數 資料 目的 使用他人已經開發好的第三方服務或者取用資料。 處理開發者自訂的複雜計算,或者企業內部業務邏輯。 檢索(模型)外部資料,藉此得到更精準與即時的資訊。 注意事項 確保API訪問權限與速率限制。若AI Agent調用太多API,可能因為回應延遲影響使用者體驗,甚至因為過度依賴外部API增加風險。 考慮函數執行的效率、順序與容錯能力,確保每個函數的輸出可正確被後續步驟使用,並妥善處理異常情況。 資料需經預先處理與索引,確保結構化數據的準確性;對非結構化資料需增加解析效率並保障隱私。 實例 - 調用地圖API獲取位置 - 調用翻譯API進行語言轉換 - 調用支付API完成交易 - 驗證用戶輸入後進行條件計算 - 在一個函數中轉換資料格式後傳遞給下個函數處理 - 人工審查後大量生成報表 - 從PDF中抽取簽約者的個人資料 - 從關聯資料庫中檢索銷售情況 - 抓取HTML文件中特定標籤的內容 資料來源:受訪者。整理:曾子軒。2025/01更新。 AI Agent擅長解決什麼問題? 從LLM興起之際,便開始出現RPA是否會被AI Agent取代的討論。對此,橡子園太平洋基金合夥人吳德威用「哲學上的矛盾」形容。他解釋,不管是辦公室或者工廠自動化,都是想省去人力,讓機器自行根據固定模式的命令行動,但生成式AI反倒帶來創造力,讓重視可控性、因而購買RPA的客戶難以信任。 當然,AI Agent有其特色,也就是善於處理非結構化的問題(unstructured probelm)。吳德威表示,在AI時代下,當AI助理回答使用者提問時,再也不需要事先準備題庫,便可以給予正確答案,甚至還能夠與使用者聊天,或者執行播放歌曲等行動。「它不能太限制於structured problem,因為處理(結構化問題)說真的,就不需要AI。」 因此,他認為訂票這類高度結構化的問題,沒必要用到AI Agent,「那是把選擇題複雜化,」只是從應用程式中供使用者選擇的框框(option box),轉移到用聲音解決。吳德威認為,AI Agent較適合的場景會從旅宿產業開始,例如入住旅館後,客人若是遇到問題會打電話向櫃檯人員求助,現在則可以向AI Agent提問。客人提的問題並不是結構化問題,但又會限縮在一定的範圍之內,這正是AI Agent派上用場的好時機。 另外,當任務複雜度提升,吳德威表示,AI Agent就會開始很難處理。「傳統的IT術語叫做configuration(配置)很多,因為決策難點太大。」他解釋,有看到想做AI秘書的新產品,但以他個人來說,因為身兼創投、顧問等多重身份,AI秘書無法協調他的行程;再以訂餐為例,現有成熟工具同樣是把複雜決策變得簡單,提供清楚選項讓人挑選,若重新用AI Agent處理,同樣是從選擇題變成問答題了。

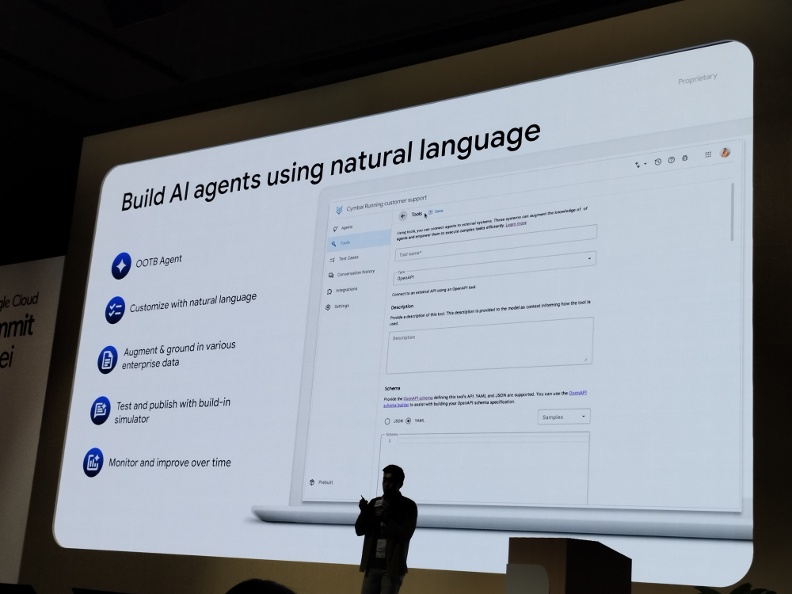

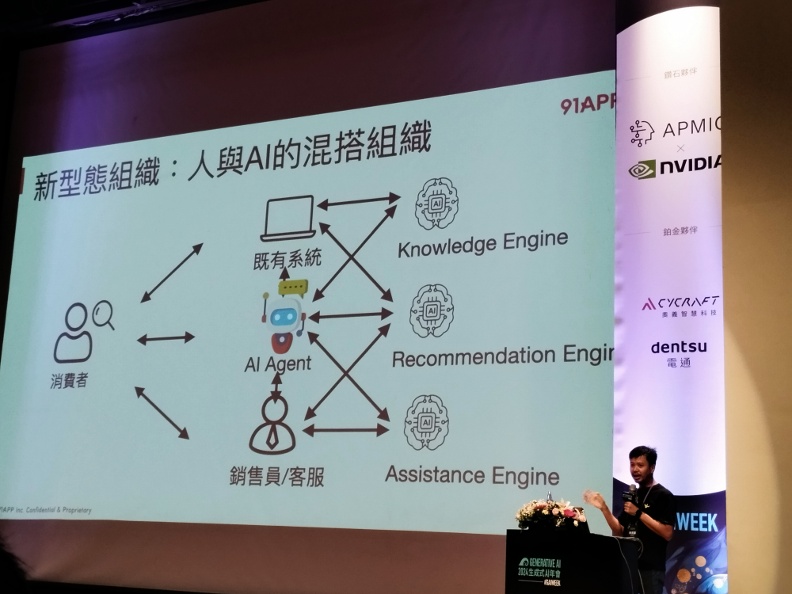

旗下產品包含面向企業的AI Agent,何建幟對於Agent適合處理的任務很有感觸。他指出,當企業與個人知道自己明確要什麼時,自然不用Agent上場;但如果需求還不明確,或者要完成的任務具有不確定性時,就有Agent出面的空間。 2025線上書展 訂一年送半年、訂兩年送一年 還有《張忠謀自傳》、《黃仁勳傳》獨家方案 正因為擁有推理能力,又能夠動態產出計畫、使用工具,何建幟表示,AI Agent不只能夠對應非結構化的資料,更可以近一步處理非結構化的問題。 AI Agent有什麼應用?當AI Agent落地時,可以分成對企業與對消費者兩種,但嚴格說來,AI Agent的應用並沒有太多限制。 陳奎翰舉例,若要請AI Agent撰寫研究報告,能夠創造出資料搜集者、資料整理者和報告撰寫者三種角色,每個角色各有專長、各司其職,例如資料搜集者可以搜尋網頁,資料整理者則知道如何以指標判斷論文好壞,報告撰寫者熟悉使用者偏好體例,集合三種角色的優勢,藉此產出品質優異的報告。 研究只是一例,從此延伸,AI Agent既能夠替白領員工分憂解勞,例如協助財務處理帳務,或者替採購詢價;也可以在日常中規劃旅遊,並完成訂餐與訂票等任務。 以面向企業(2B)來說,客服是此刻最常見也最成熟的AI Agent應用領域。無論是Google Cloud或者AWS,介紹AI Agent服務時,同樣都以客服為實例,有些是讓AI Agent退居幕後,當客服人員回答客人問題時遇上困難,可以快速詢問AI Agent,有些則是直接讓AI Agent上場回答問題。

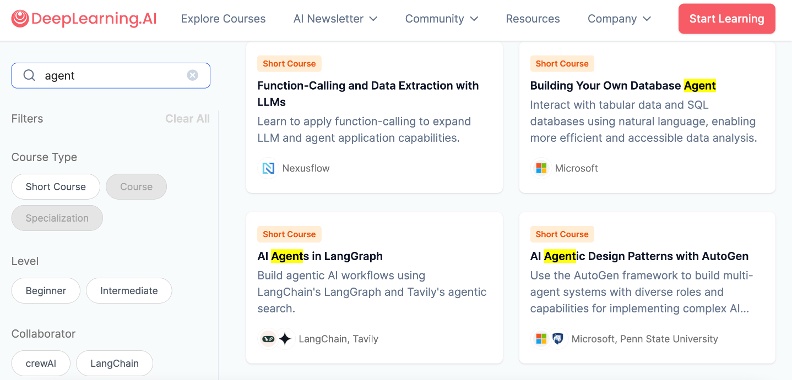

以面向個人(2C)來說,最能讓人理解、也最好想像的AI Agent,就是《鋼鐵人》的人工智慧管家Jarvis,這類AI助理,是目前效益最為明顯的生活化應用,相似案例有Apple的Apple Intelligence,以及Google的Project Astra。 事實上,先前曾一度引發關注的AI Pin,也是AI Agent化身為硬體的展現,但因為回答等候時間過長、耗電量大、無法有效採取行動等限制,讓AI Pin走向失敗道路;但可以預想,當人手一支的手機搭載的AI Agent更具智慧,會讓消費者更有意願下單。 AI Agent有哪些挑戰?若從LLM的能力和特性出發,其善於生成內容的能力,反倒成為AI Agent應用遇上障礙的根源。 理想的AI Agent面臨未知問題時,應該都能夠游刃有餘地拆解,根據已知資訊擘畫出完整的行動藍圖。然而,本該被視作賜福的推理能力,反而成為注重穩定的企業在導入AI Agent時遇上的痛點。 《經濟學人》在2024年底預期2025年的AI趨勢時,便曾指出發展AI Agent上,至少有因為推理導致成本推升、因為在現實世界產生後果牽涉到信任、因為執行任務的資料遠遠少於對話等挑戰。 《遠見》2024年中實際採訪時,受訪者也紛紛表達AI Agent潛在的問題。 AI Agent挑戰 - 不可預測性專攻金融法遵的新創Parcha曾以「Agents aren’t all you need」為題,指出AI Agent應用上的問題,其中有個段落令人深思:「如果AI Agent自主執行由10個任務組成的工作流程,但每個任務的錯誤率為10%,整個工作流程的複合錯誤率為 65%。」 雖然只是簡單的伯努利分布和冪次運算,但有數字支撐的論述清楚易懂。Parcha的進一步解釋,AI Agent處理問題時,每次都會有彈性、有創意地重新提出計畫,但這帶來幾個問題:不可預測性、高度相互依賴、效能瓶頸以及難以評估與改善。 楊建洲也分享,要賦予AI Agent多少彈性和自由度,是他所在團隊內部也在討論的事情。「在AGI(通用人工智慧)的世界還沒有來臨之前,大家都會想要用AutoGen這種free-run(自由運行)的方式。」 楊建洲所說的AutoGen,由微軟、賓州大學和華盛頓大學攜手開發出,是一種讓多位Agent彼此交流,以此解決任務的框架,開發者能夠利用AutoGen打造大語言模型應用。市場上熱門的LLM應用開發框架LangChain、LlamaIndex,也陸續推出支援使用者打造Agent的功能和語法。 除了AutoGen以外,楊建洲補充,吳恩達曾多次介紹的crewAI,也是讓一位Agent扮演指揮官角色,推動其他Agent協作,「像個團隊、像天龍特攻隊(A-team)一樣彼此協作、完成任務,大家在想像那個世界。」 不過,就現有技術發展來說,要讓Agent彼此緊密合作並非易事,因此以達哥團隊來說,會預先定義好「Agentic Workflow」(代理工作流程),讓AI Agent能夠知道自己要執行哪些任務。 楊建洲以日本旅遊為例,事先定好的重要行動就是訂機票、訂飯店和租車 ,「我們會把流程(flow)定義好,一定就只做這三件事。」至於AI Agent的推理與反思等能力,則可以用在個人化上,例如使用者荷包很厚,就能訂價位較高的機票。 「這個pre-defined的流程,它會回歸到我們剛才講機器人流程自動化(RPA),但是每一個節點上,卻又具有GenAI的能力,每個點都去做一個決策,但不用真的從零很自由的發想。」先設計好流程,就好像替AI Agent繪製地圖一樣,既不會出現超出範圍、神來一筆的行動,又能夠保有彈性,讓Agent在規定的空間內發揮其自主能力。

除了推理與規劃能力不足,尚且無法真正做到「從零到一」的解決問題以外,當AI Agent對外時產生錯誤,容易替企業帶來傷害。 吳德威表示,現在AI Agent的發展,有如Google Map問世的第一年,「還是會很容易找錯路。」近期,就遇到生成的內容有誤、不符事實的問題,例如建議使用者用膠水讓起司可以黏住披薩,或者指稱地質學家表示人們每天都可以吃一塊石頭。 「Google可以受這樣的傷害,但是品牌沒辦法受這樣的傷害。」吳德威強調,只要是認真打造品牌的企業,做法上一定較為保守。當AI Agent直接面對客戶時,即便有能力自由對話,但目前還是會加上人工檢查,例如,內建於電信商應用程式的客服Agent,若是根據封裝知識,反倒向使用者推薦競品,只要出錯一次,就會影響品牌客戶的信任感。

陳卓翰的想法與吳德威類似。他舉例,當AI Agent應使用者需求,前去電商網站下單,人們也會憂心,當Agent做出決策後,準備要刷卡時,自己到底是否能夠相信它的決策,「還是要人去決定,這會有信任問題。」。 AI Agent挑戰 - 行動上的障礙AI Agent在數位世界行動時,可行作法包含直接走官方通道,也就是接上其他服務的API;或者模擬人類作法,撰寫腳本完成任務。前者的挑戰在於可能撞上企業生態系的壁壘,例如電商平台不願開放API給購物Agent,後者的限制則在於費時。 舉例來說,購物Agent能夠自行到電商平台上比價,並根據使用者預算挑出合適品項。楊建洲表示,可以預想電商可能不願意開放API給使用者的Agent,因為只有真人消費者會有衝動購物、被折扣誘惑的行為。 不過,他並不擔心這個問題,因為他預期未來使用者與服務之間,都會使用AI Agent互動。目前,「達哥」團隊已在著手進行Agent與真人的互動,例如讓Agent打電話訂餐,接下來則會出現Agent之間自行溝通。 「秘書最痛苦的就是協調多個主管的會議時間,但秘書可以請代理人,也就是達哥,去跟每一個主管的代理人直接溝通,討論會議時間後約會議室、寄出邀請和開會議程,中間都沒有人介入。」

吳恩達在2024年6月撰文指出,如果說向LLM下命令、取得回覆的單次互動(one-shot)明顯不是Agent,能夠規劃、使用工具並多次迭代改進的明顯就是Agent,兩者間存在著灰色地帶。 因此,比起二元地決定什麼是Agent、什麼不是Agent,他更傾向於使用形容詞「Agentic」,用以衡量AI系統貼近Agent的程度。他也補充,就他觀察,會使用Agentic的主要都是技術人員,因此當他看到文章討論「Agentic」的工作流程時,更有可能點開閱讀,「因為它(文章)比較不會是行銷噱頭,而是懂得技術的人所寫。」 其實,不管是Agent或者Agentic,同樣是用來描述Agent的方式。談論AI Agent時,人們會用AI Agent應該具有的能力試圖定義它,不過,其實我們也能用完成任務的流程介紹AI Agent。 上述提到的種種能力,如分拆指令、規劃、使用工具等,其實就是AI Agent接受人類指派工作後,起身行動的過程。因此,才會有將重點放在如何設計出AI Agent的AI工程師或者AI領域的從業人員,使用「AI代理工作流程」(AI Agentic Workflow)一詞談論AI Agent。

黃仁勳在資訊服務軟體商ServiceNow年會的演講中,分享趨勢時,提到AI Agent的過去、現在與未來。 「現今大多數的AI都是一次性的(one-shot)。你給它一個提示,它會立即生成建議。未來的AI將是多次互動(multi-shot),並成為基於推理的系統,就像我們(人類)在各種複雜情境之下做出計劃一樣,它將自行規劃,⋯⋯擁有多步推理的人工智慧即將到來,這些AI將愈來愈多地用於代理應用(agentic use)。」 黃仁勳表示,現在已經見到能夠使用工具、調取個人化資訊的AI,能力益發提升,「AI像我們公司的員工一樣在其中一起工作,⋯⋯我們將擁有顧問人工智慧,專業人工智慧,和通才人工智慧,」AI Agent不只跟人互動,未來即將看到AI Agent彼此之間互動。 (责任编辑:) |